概要

- Ivantiの2025年版Technology at Workレポートに示されているように、職場におけるシャドーAIの利用は急速に増加しています。

- オープンな対話と明確なポリシーは、責任あるAI利用を促進し、シャドーAIや無料AIツールに関連するリスクを最小限に抑えます。

- 従業員と協議してAI利用のニーズを把握しながら、段階的かつ管理された実装を進めることで、セキュリティリーダーはビジネス目標とセキュリティ要件のバランスを取ることができます。

職場におけるAIツールの利用は急速に拡大しています。かつては高度に専門化された技術職の領域だったものが、今では一般的になっています。Ivantiの2025年版Technology at Workレポートによると、オフィスワーカーの42%がChatGPTなどの生成AIツールを職場で使用していると回答しており、前年から16ポイント増加しています。

問題は、こうした生産性向上が非公式な形で起きていることです。生成AIツールを使用していると回答した人のうち46%は、使用しているツールの一部または全部が雇用主から提供されたものではないと述べています。また、3人に1人の従業員は、AI生産性ツールの利用を雇用主に知らせていません。

生成AIツールは生産性を大きく高める可能性があります。しかし、特に雇用主の監督なしに使用される場合、データセキュリティ上のリスクにもなります。

シャドーAIとは

承認されていないAIの利用は、シャドーIT(IT部門の承認なしにテクノロジーを使用すること)の一種にほかなりません。

シャドーAIがもたらすリスクは、他のシャドーITリスクと似ていますが、そこに懸念がさらに加わります。それは、生成AIが効果を発揮するために必要とする膨大な量の専有データです。無料の生成AIツール(一部の有料ツールも同様)は、モデルのトレーニングに組織のデータや従業員の検索内容を使用する場合があり、データ漏えいやコンプライアンス違反のリスクを増幅させます。

共有されたChatGPTの会話が検索エンジンにクロール可能だったという最近の発覚(OpenAIはすぐに方針を変更しました)は、適切な管理がなければ、第三者が望ましくない形でデータを使用し得ることへの警鐘となるはずです。ChatGPTを含む一部の無料ツールはセキュリティポリシーに準拠するよう設定できますが、従業員がそれらをひそかに使用している場合、それは不可能です。

ChatGPTのような無料ツールだけがシャドーAIのリスクではありません。意外な発生源は、実は既存のソフトウェアです。AI機能の追加が急速に進む中、以前はIT部門が承認していたツールが新たなリスクをもたらす可能性があります。情報セキュリティチームがこれらの新機能を把握し評価していなければ、実質的にサードパーティリスク管理プロセスを迂回してしまうことになります。

AIにリスク優先アプローチが不可欠な理由

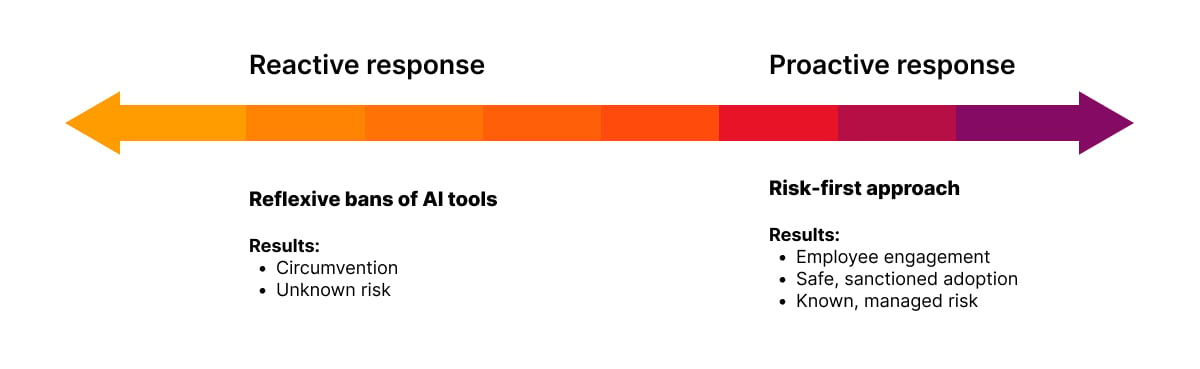

生成AIであれ他のツールであれ、シャドーITは、ツールをテストしたり業務を遂行したりするための明確で合理的な方法がないことから生じます。AIがなくなることはない以上、企業は導入に先回りして取り組む必要があります。ツールを禁止しても、従業員が生産性を高め、仕事をしやすくするために使おうとすることを止められるわけではないからです。

私は業務時間の大半を、AIツールがもたらすリスクを含め、リスク評価に費やしています。多くの場合、ビジネスを改善する機会に関連してリスクを評価する必要があります。今回で言えば、従業員の生産性向上と、従業員満足度やより戦略的なプロジェクトに取り組む時間の確保といった二次的な影響です。

要するに、私たちが問うべきなのは、従業員が求めているツールを導入し、そのメリットを得ながら、リスクを許容可能なレベルに抑える方法はあるのか、ということです。

そこで重要になるのが、リスク優先アプローチです。AI導入におけるリスク優先アプローチでは、AIに入力する必要があるデータと、第三者がそのデータをどのように扱うかに焦点を当てます。このアプローチはベンダーリスク管理に似ており、組織は確立された手法やプロセスを活用しつつ、AIに特化した質問に合わせて調整できます。

確認すべき主な質問は次のとおりです。

- 私たちのデータはAIモデルのトレーニングに使用されるのか。

- 私たちのデータはどのくらいの期間保持されるのか。

- 私たちのデータが公開されるリスクを低減するために、どのような保護策があるのか。

- AIを使用して生成された知的財産の権利は誰に帰属するのか。

AIの無秩序な拡散を最小限に抑えることは、この取り組みにおいて極めて重要です。専門化されたAIツールを導入するベンダーが増え、さらにベンダーを追加してそのAIツールに自社データへのアクセスを許可するほど、リスクは高まります。これは、コストや契約の変更なしに突然AIを導入する既存ツールにも当てはまり、AIツールの正確なインベントリを維持することを難しくします。

IvantiにおけるAIガバナンスフレームワークの導入

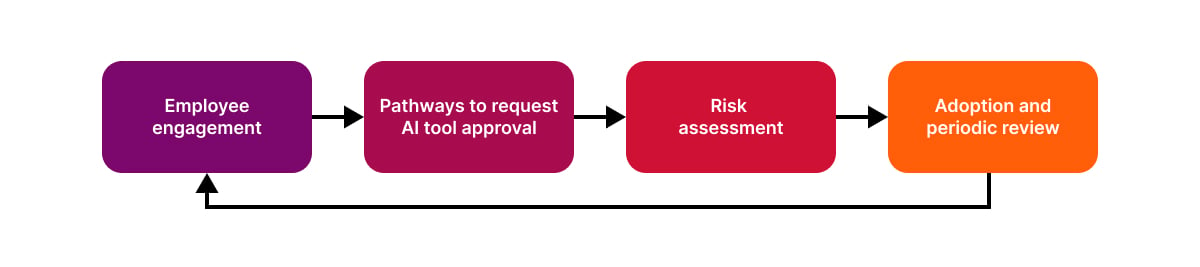

Ivantiでは、従業員エンゲージメントを出発点かつ到達点とするリスク優先アプローチで、シャドーAIに対処しています。

AI利用を見える化する

シャドーAIを推奨することは決してありませんが、それを使用している従業員は、AIをワークフローに統合する方法について共有すべき貴重な知見を持っています。そのため、すべてのAI利用を禁止するのではなく、従業員が業務で使用するAIツールを申請する明確な手段を確保し、オープンな対話の機会を定期的に設ける必要があります。

オープンな対話を促進することで、従業員は自分たちの成功に役立つツールについて安心して話し合えるようになり、最終的にはそれらのツール(または同等のツール)を安全に使用するようになります。これは、制限を回避しようとするのではなく、従業員が適切なガバナンスの策定に積極的なパートナーとして関わる機会になります。

AIの実装と導入に対する慎重なアプローチ

ツールが承認されたら、適切に実装されていること、そしてどのデータへのアクセスを許可したのかを把握していることが重要です。これは、生成AIツールが組織にもたらすデータガバナンスとセキュリティリスクを考えると、特に重要です。データガバナンスの観点からAIを見ることで、AIリスクの多くの側面に対処しやすくなります。

Ivantiでは慎重なアプローチを採用しています。専任チームを置き、他のチームと連携して生成AIツールの管理されたテストを実施します。その後、フィードバックループを確立し、混乱を避けるため導入を段階的に進めます。

AIツールのフィードバックループを構築する

継続的に確認すべきことは次のとおりです。

- Ivantiの従業員はAIをどのように使用しているのか。

- そのAIを有用だと感じているのか。

- どのようなフィードバックがあるのか。

- そのツールをどのように改善できるのか。

こうした継続的な対話により、従業員の生産性ニーズを満たしながら、責任ある形でAIを使用できるようになります。

AIブームに安易に乗ることが目的ではありません。重要なのは、それがビジネスにとって、そして利用する人々にとって価値があるかを見極めることです。シャドーAIは一人の生産性を高めます。しかし、その生産性を組織全体に広げることができれば、会社全体にとって意味のある改善につながります。

シャドーAIに先回りして対処する

ここで一貫しているテーマは、AI、特にシャドーAIが新たで懸念すべきリスクをもたらす一方で、今後も存在し続けるということです。見えないところでAIを使用している従業員に悪意があるわけではありません。むしろ、たとえ方法が適切でないとしても、ビジネスに貢献しようとしているのです。

先回りしたAI導入へのリスク優先アプローチは、この現実を認識するものです。回避を促すだけの事後的な禁止ではなく、従業員がAIで解決しようとしている課題を理解するために関わり、当社のセキュリティおよびデータプライバシー要件を満たす安全な選択肢を提供する必要があります。

よくある質問

シャドーAIとは何ですか?

シャドーAIとは、従業員がITチームやセキュリティチームの認識なしに、承認されていないAIツールを使用するシャドーITの一種です。

シャドーAIは企業データをどのようにリスクにさらしますか?

シャドーAIは、公式な監督や保護策の外で運用されるため、専有データを露出させ、セキュリティ脅威を招く可能性があります。

AI導入におけるリスク優先アプローチとは何ですか?

AI導入におけるリスク優先アプローチとは、AIツールを実装する前に、潜在的なデータセキュリティリスク、プライバシー、知的財産に関するリスクを評価し、管理することを意味します。

企業はAIツールをどのように安全に導入できますか?

企業は、AIツールを安全に申請・使用するための明確なポリシー、リスクに関する継続的な教育、承認済みのチャネルを提供する必要があります。